[챗GPT발 AI 대전]대표 수혜자 SK하이닉스 'HBM3' 기대감 고조[반도체]챗GPT에 쓰인 메모리 제품 공급, 4세대 HBM3로 AI 진화 기여

원충희 기자공개 2023-03-16 12:42:37

[편집자주]

챗GPT가 쏘아올린 인공지능(AI) 검색엔진과 하이퍼스케일 AI 등이 순식간에 메가 트렌드로 부상했다. 누군가는 미래에 대한 기대를, 누군가는 위협을 느끼고 대응책을 마련 중이다. 국내에서도 반도체, IT·플랫폼, 게임, 블록체인 기업들이 이 변화를 놓치면 도태된다고 판단해 기존 비즈니스에 AI를 접목하거나 신사업에 뛰어들고 있다. 주요 테크기업의 AI 전략을 짚어보고 특장점이 무엇인지 청사진을 들여다본다.

이 기사는 2023년 03월 15일 07:37 thebell 에 표출된 기사입니다.

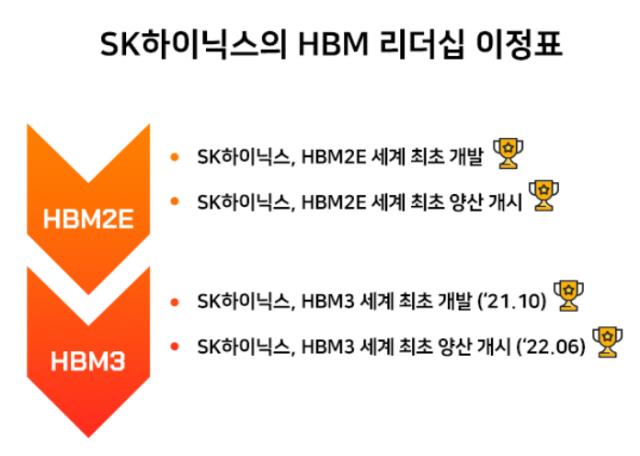

미국 오픈AI가 선보인 대화형 인공지능(AI) 챗봇 '챗GPT'를 가동시키기 위해선 고성능 그래픽처리장치(GPU, Graphics Processing Unit)가 필수다. 여기에는 고대역폭 반도체(HBM, High Bandwidth Memory)가 들어간다. 메모리 반도체 강국인 한국은 HBM에서도 글로벌 톱클래스의 경쟁력을 자랑한다. 특히 SK하이닉스는 HBM 기술의 혁신을 주도하며 최초 타이틀을 지켜왔다.챗GPT가 촉발한 글로벌 AI 기술 주도권 경쟁에서 SK하이닉스가 대표 수혜자로 꼽히는 이유다. 2021년 10월 디램(DRAM) 반도체의 일종인 HBM 4세대 제품 'HBM3'를 개발, 지난해 양산 돌입과 함께 엔비디아(NVIDIA)에 공급을 시작했다. 엔비디아는 AI의 두뇌 역할로 쓰이는 GPU 시장의 90%를 차지하는 업체다.

◇3세대 HBM2E 이어 4세대 HBM3도 공급

현재 AI 기술은 GPU를 기반으로 한다. 각종 대규모 병렬 연산에 강점을 가진 반도체 덩어리인 GPU는 원래 그래픽 처리에 사용됐으나 AI 기술이 대규모 병렬 연산을 통해 구현 가능해지면서 이 분야에서도 큰 인기를 끌고 있다. AI는 수십억개의 인공신경망에 데이터를 투입해 신경망을 학습시키는 방식으로 만들어진다. 신경망을 확장하기 위해선 우수한 메모리 반도체가 필요하다.

메모리를 일종의 데이터 창고로 보면 대역폭은 창고로 들어오는 도로의 너비다. 도로가 넓을수록 한 번에 지나다닐 수 있는 차량 수가 많은 것처럼 창고에서 많은 양의 데이터를 한 번에 빼낼 수 있다. HBM은 대역폭과 용량에 중점을 두고 개발된 메모리 반도체다. 고성능 그래픽 처리를 위해 탄생한 제품이다.

SK하이닉스는 2021년 10월 개발 성공한 HBM3를 지난해부터 양산에 돌입했다. 대표적인 고객사가 엔비디아다. 작년 3분기부터 16GB 용량의 HBM3를 엔비디아에 공급하기 시작했다. 4세대 제품인 HBM3는 초당 819GB 데이터를 처리할 수 있는 반도체로 풀HD급 영화 163편을 1초 만에 처리할 수 있는 속도다. 3세대(HBM2E) 제품보다 데이터를 처리할 수 있는 속도가 80% 빠르다.

SK하이닉스는 앞서 3세대 제품인 HBM2E를 엔비디아에 공급해 왔다. 이는 챗GPT에 쓰인 GPU A100에 들어가는 반도체다. 이번에 공급된 4세대 HBM3는 엔비디아가 초고속 AI 기반 첨단기술 시장 공략을 위해 준비하는 GPU 신제품 H100과 결합한다. 이를 통해 훨씬 더 진화한 챗GPT를 만나볼 수 있을 것으로 전망된다.

◇GPU 시장 90% 석권한 엔비디아와 파트너십 강화

SK하이닉스는 2013년 세계 최초로 HBM을 개발한 이래 HBM 산업의 형성과 확장에 기여해 왔다. 2019년에는 HBM2의 확장 버전인 HBM2E을, 2021년에는 HBM3를 잇따라 선보이며 고성능 메모리 솔루션 분야의 리더십을 입증했다. 반도체 생태계의 주요 파트너들과 함께 미래 AI 환경을 혁신하는 데 더 중요한 역할을 할 수 있다는 가능성을 보여줬다.

엔비디아는 지난해 6월 GTC2022(GPU Technology Conference 2022) 기조연설에서 "H100 Hopper GPU 및 DGX H100 시스템에 HBM3를 채택한다"고 공식 발표했다. SK하이닉스의 HBM 기술이 챗GPT의 성공에 기반에 있다는 것을 엔디비아가 인정한 격이다.

기존 HBM의 구조와 성능의 기술적 한계에 대해 논쟁은 여전히 지속되고 있으나 SK하이닉스는 디램상품기획 조직을 중심으로 HBM 기술 한계를 극복할 차세대 제품과 솔루션을 개발, HBM 시장에서의 리더십을 더욱 공고히 할 예정이다. 차세대 HBM 제품 역시 고객의 요구에 완벽하게 부합하는 완성도 높은 제품으로 개발될 수 있도록 사전 준비를 진행 중이며 업계 내 주요 파트너와의 협업도 지속하고 있다.

< 저작권자 ⓒ 자본시장 미디어 'thebell', 무단 전재, 재배포 및 AI학습 이용 금지 >

관련기사

best clicks

최신뉴스 in 전체기사

-

- 스튜디오산타클로스ENT, 주주권익 보호 '구슬땀'

- 이에이트, AI 시뮬레이션·디지털 트윈 기술 선보여

- MBK, '몸값 2조' 지오영 인수 SPA 체결 임박

- [2024 더벨 글로벌 투자 로드쇼-베트남]한인이 설립한 RCE, 세계 첫 ‘중장비 온라인 중고거래’

- 회계법인 해솔, 부동산 타당성 자문 업무협약

- [2024 더벨 글로벌 투자 로드쇼-베트남]베트남의 지오영 '바이메드'·전기오토바이 '셀렉스' 눈길

- 지아이에스, 코스닥 상장 위한 예비심사신청서 제출

- [꿈틀대는 토큰증권 시장]'업계 표준' 루센트블록, '두자릿수' 레코드 조준

- [Company & IB]조달 '막바지' 롯데그룹, 롯데케미칼에 쏠리는 눈

- '910억 CB 발행' 아스트, 경영 정상화 속도 낸다

원충희 기자의 다른 기사 보기

-

- [기업집단 톺아보기]실적 저하에도 현금 쌓이는 삼성SDS

- [기업집단 톺아보기]삼성전기, 4년 만에 잉여현금흐름 순유출 전환

- 경영진 인센티브의 명암

- [기업집단 톺아보기]삼성SDI, 1조 번 배터리에 시설투자 4조

- [기업집단 톺아보기]삼성디스플레이, 전자 배당에 현금 보유량 감소

- [기업집단 톺아보기]삼성전자, 늘어진 현금 사이클…해법은 '매담대' 확대

- [밸류업 프로그램 리뷰]한미반도체, 트렌드·장래성·주주환원 '3박자'

- [기업집단 톺아보기]'그룹 핵심' 삼성전자, 반도체 재고 증가폭 둔화 '숨통'

- [밸류업 프로그램 리뷰]배당주 코리안리, 자사주 대신 무상증자 택한 이유

- [밸류업 프로그램 리뷰]삼성전자, 연 10조 배당…믿는 구석은 반도체 '흑전'